추가설명자료: 인간 중심의 인공지능

이 추가설명자료는 [5화 스토리텔링 속 표현의 참뜻]의 [1. 새로운 세상이란 표현의 명확한 의미]에서 언급된 ‘인간 중심의 인공지능’에 대한 별도의 추가설명자료이다.

‘HCAI’는 말 그대로 사람을 최우선으로 생각하는 사람을 중심으로 하는 인공지능을 구현하는 접근 방식이다. 이 말은 HCAI는 인간을 대체하려는 것이 아니라 인간에게 지원과 도움을 주고, 인간의 삶을 지배하는 것이 아니라 풍요롭게 하는 것을 목표로 한다는 것이다. 그래서 HCAI는 다음과 같은 디자인 철학으로 묘사되기도 한다. “단순히 성능을 극대화하거나 사람의 역할을 대체하고 작업을 자동화하기 위해 인공지능을 만드는 것이 아니라, 인간의 가치와, 요구 그리고 경험을 지원하기 위해 디자인한다”고 말한다.

고귀하게 들리고, 실제로도 그렇다. 하지만, 잠시 생각해 보면 더 깊은 질문이 떠오른다. 인공지능은 실제로 누구의 가치, 누구의 이해, 누구의 공정성을 대변하는 것일까? 사람의 요구와 필요에 따라 지원하고, 그 사람이 살아온 삶의 흐름이 가지는 경험을 지원하면서 도움을 주는 인간 중심의 인공지능이라는 것은 어느 정도 이해가 간다.

하지만, 사람의 가치를 지원한다는 것은 훨씬 더 복잡하고, 자칫 사람의 가치가 인공지능에 의해 더해지거나 감소될 수 있다는 의미로 받아들여질 수 있기 때문에 매우 조심스러운 표현이 된다. 이는 기술적인 문제가 아니라 도덕적인 문제라는 생각이 든다

진실은 간단하다. 모든 인공지능 시스템은 만드는 사람의 마음을 담고 있다는 것이다. 인공지능의 공감, 공정성, 또는 민감성은 항상 디자이너의 성격과 세계관을 담고 있다. 시스템은 도덕적 이해력을 가지고 있지 않고, 단지 인간이 부여한 논리, 가정, 그리고 우선순위를 물려받을 뿐이다. 결국 그 인공지능 시스템의 모든 것은 그것을 구축하는 디자이너의 성품과 인성에 의존할 수밖에 없다는 것이다. 그렇다면, 말은 쉽게 공정성을 지원하는 인공지능 시스템이라고 했지만, 사실 이런 공정성을 달성하기가 매우 어려운 도전이 되는 것은 아닐까? 왜냐하면 그 공정성도 디자이너에게 달려있기 때문이다.

인공지능 시스템이 편견이나 차별 없이 사람을 공평하게 대우해야 한다는 그 공정성이 어떤 의미를 가져야 하는지 쉽게 정의 내리기도 쉽지 않지만, 정의를 내렸다고 하더라도 결국 인공지능은 구축하는 사람의 성품과 인성에 따른 것이기 때문에 그 디자이너가 그렇게 디자인해야 한다는 것이다. 컴퓨터 시스템 자체는 사람을 판단할 수 없다. 인공지능도 사람을 판단할 수 없다. 옳고 그름을, 공정성과 편애를 구분할 수 없다는 것이다. 그러한 판단은 역시 인간의 몫이다. 시스템은 단지 디자이너가 부여한 도덕적 구조를 나타낼 뿐이다.

인공지능 시스템이 “모든 사용자에게 동등한 기회”를 제공한다고 말할 때, 실제로 우리가 의미하는 것은 디자이너가 이를 보장하려고 노력했다는 것이다. 공정성은 기계 자체에 있는 것이 아니라, 그것을 만든 인간의 의도에 있기 때문이다. 그렇기 때문에 HCAI 디자인은 단순한 공학적 과제가 아니라 도덕적 책임이 따르는 행위인 것이다.

그렇다면 자연스럽게 또 다른 질문이 생긴다. 디자이너들은 어떻게 진정한 “인간적 가치”가 무엇인지 스스로 알 수 있을까? 자신의 시스템이 보호하고 준수해야 할 기준을 어떻게 확립할 수 있을까? 인공지능 시스템은 디자이너가 목표가 설정되면 그 목표에 맞게 업데이트 되거나 업그레이드될 뿐이라는 것이다.

이것이 핵심 과제이다. 디자이너들이 인간의 생명, 존엄성, 그리고 가치를 존중한다는 것이 무엇을 의미하는지에 대한 명확하고 절대적인 기반을 갖추지 못한다면, 알고리즘이 아무리 발전하더라도 그들의 창작물은 단지 인간의 결함, 즉 편견, 오만, 자존심, 이기적인 야망을 디지털 속도로 재현할 뿐이기 때문이다.

그렇다면, 인간 중심의 인공지능 시스템을 디자인하기 위해 디자이너가 실수 투성이고, 자기는 아니라고 하지만, 이기적인 자기의 생각에서 벗어나, 진정으로 사람들을 위한, 진정한 인간 중심의 인공지능 시스템을 디자인하기 어쩔 수 없이 따라야 하는 최초에 가치관을 제공해줄 기준이 필요하다는 것이다. 그렇다면 무엇을 최초의 가치관의 기준으로 삼고 디자인해야 할까?

- The Myth of the Impartial Machine, 2019, https://parametric.press/issue-01/the-myth-of-the-impartial-machine/

- Fairness and AI, Sandra Wachter, 2020, https://medium.com/berkman-klein-center/fairness-and-ai-c5596faddd20

따라서 진정으로 인간 중심적인 인공지능은 단순히 데이터, 논리, 또는 최적화만으로 탄생할 수 없다. 도덕적 근거, 즉 인류의 가장 깊은 진실을 이해하고 옹호하고자 하는 디자이너로부터 탄생해야 한다. 그래서 인공지능 시스템이 인간 중심이 되기 위해서는 디자인할 디자이너가 가지고 갈 기준이 되는 기반이 반드시 있어야 한다. 그러한 기반 없이는 HCAI는 단지 흔한 상업적 슬로건일 뿐이다. 하지만 그것이 갖춰진다면, HCAI는 우리의 가장 좋은 모습을 담을 수 있는 살아있는 시스템이 될 것이다.

결국, 질문은 “인공지능이 어떻게 인간을 이해하게 할 수 있을까?”가 아니다. 질문은 “인간은 진정으로 이해할 가치가 있는 것이 무엇인지 어떻게 정의할 수 있을까?”이다. 그리고 이는 우리를 성찰과 도전으로 이끈다. 디자이너가 인간이기 때문에 따라서 불완전하다면, 진정으로 인간 중심적인 무엇인가를 디자인하기 위해서는 먼저 디자이너 자신을 넘어서 보아야 한다. 그들은 개인적인 판단보다 더 높은 기준, 문화나 편의에 흔들리지 않는 나침반을 찾아야 한다.

그렇다면 인간의 가치를 정의하고 공정성, 존엄성, 그리고 사랑을 측정할 수 있는 기준을 제시하는 그 토대는 무엇일까? 아마도 이 질문이 모든 진정한 인간 중심의 인공지능 시스템 디자인의 시작일 것이다.

인간 중심의 인공지능은 단순히 지능만을 중시하는 것이 아니라, 사람의 주변 맥락을 이해하고 존중하는 것이라고 할 수 있다. 여기서 사람의 주변 맥락이라는 것은 어떤 순간의 상황(Situation)을 그 중심에 있는 사람에게 의미 있게 만드는 모든 요소들을 말한다. 즉, 실제 환경 속에서의 물리적 요소들, 사람의 감정 상태 혹은 감정과 연관 지을 수 있는 그 사람의 문화, 습관, 또는 주변 사람들, 그 상황에서 기분을 좋게 만드는 것과 그렇게 연관 지을 수 있는 대상, 그 대상이 그 중심에 있는 사람에게 주는 분위기, 심지어 그 사람의 조금 넓게 봐서 사회적 또는 문화적 배경까지 포함한다는 것이다. 이렇다는 것은 시스템을 구축하기 위해 매우 심오한 기술이 필요하다는 말과 같다.

단순히 그 사람이 언제 그리고 어디에 있는지 만이 중요한 것이 아니다. 훨씬 더 많은 요소가 있어야 한다. 예를 들어 이런 부분도 필요하다. 누군가 밤에 어두운 방에서 조용히 이야기하고 있다면, “인간적 맥락”을 중요하게 생각한다면, 그 사람이 피곤하거나 다른 사람을 깨우지 않으려고 애쓰고 있다는 것을 알려준다는 것이다. 물론 후자에게 더 많은 가치를 제공하게 된다. 어떤 대상이 어떤 상태로 그 사람에게 다가가게 되는지가 중요한 요소가 된다는 것이다. 이와 유사하게 스마트하고 인간 중심적인 디지털 공간이라면, 갑자기 큰 소리를 내지도 않겠지만, 갑자기 밝은 불빛을 비추지도 않을 것이다.

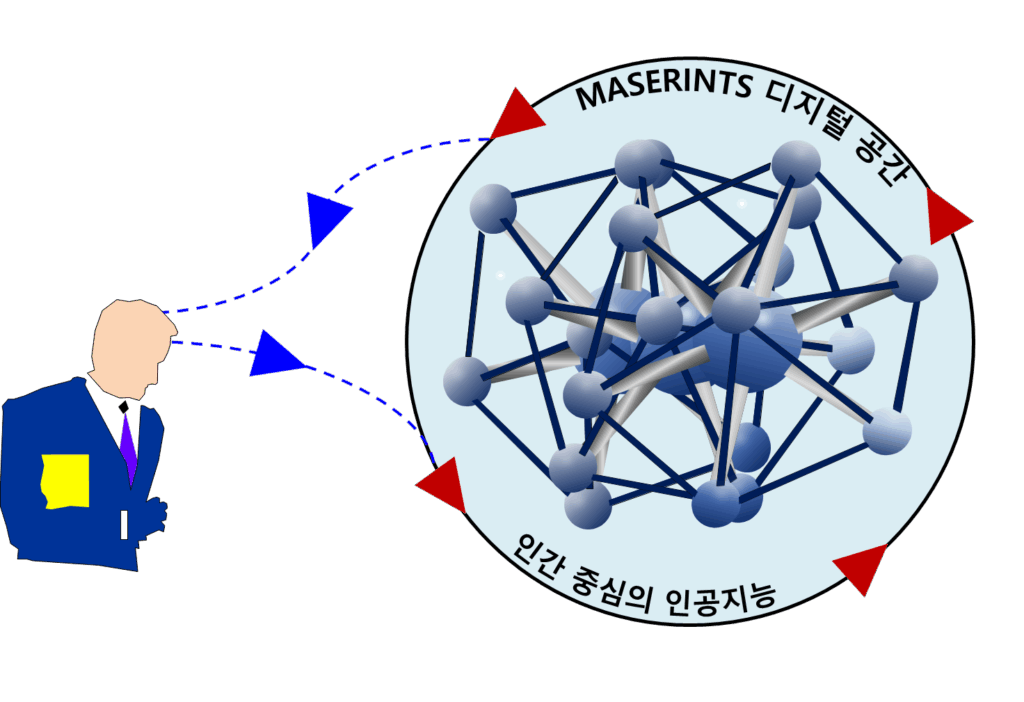

그 순간 짧은 시간 속에서 가지는 상황(Situation)에 대해서 인간적인 측면을 이해하고 그에 대해 적절하게 반응하고 대응할 것이다. 결국, 사람과 그 짧은 시간 속에서 처한 상황(Situation)을 알아차리고, 최초 상황과 연관되는 무수히 지속되는 연속적인 상황들에 대해서 반응하는 기술을 디자인하는 것이다. 이러한 상황의 연속이 맥락을 만들고, 그 중심에 인간이 있기 때문에 ‘인간적 맥락’이라고 하며, 그래서 인간적 맥락은 인터랙션을 필요한 정도로 적절하게 하고, 공간과 사람, 사람과 사람 간의 배려심이 있도록 하고, 삶의 흐름 속에서 자연스럽게 느끼게 하는 요소로 작동하는 것이다. MASERINTS는 이 점을 매우 중요하게 생각한다.

단순히 시스템을 더 똑똑하게 만드는 것만이 아니다. 현명한 시스템을 만든다고 표현하면 어떨까? 시스템을 올바른 방식으로 사람에게 문제 해결의 단서와 실마리를 제공하는 더 현명하게 만드는 것이다. 이것이 스마트하다는 것이다.

예를 들어, 집에서 노인을 돕는 인공지능 시스템은 단순히 효율적이어야만 하는 것이 아니라, 노인이 신뢰할 수 있고, 그 안에서의 삶에 대해 이해하기 쉬우며, 노인의 신체적, 정서적 상태에 민감해야 한다는 것이다. 노인들에게 디지털 공간이 신뢰와 이해를 얻기 위해서, 그리고 신체적, 정서적으로 안정되게 하기 위해 그 디지털 공간은 사람이 중심이 되어 그에 걸 맞는 공간과 환경을 제공하려고 하고 필요한 지원과 도움을 제대로 받기 위해 천천히, 그리고 명확하게 방향을 유도하거나 인도할 수 있어야 한다.

자주 언급하는 표현이지만, 인간 중심의 인공지능 시스템도 역시 사람이 컴퓨터에 적응하도록 강요되고 유도되는 것이 아니라, 무조건 기술이 인간에게 적응하도록 해야 한다. 모든 통제는 그 중심에 있는 사람이 의식적으로 수행하는 것이 아니라, 그 사람의 삶에서 그런 디지털 공간에게 가하는 통제가 그냥 나오는 것이다. 모든 명령이 그 사람이 주는 것이 아니라, 그냥 그 사람의 삶 속에서 저절로 나오게 되는 것이다. 그것을 디지털 공간이 받아들이는 것이다.

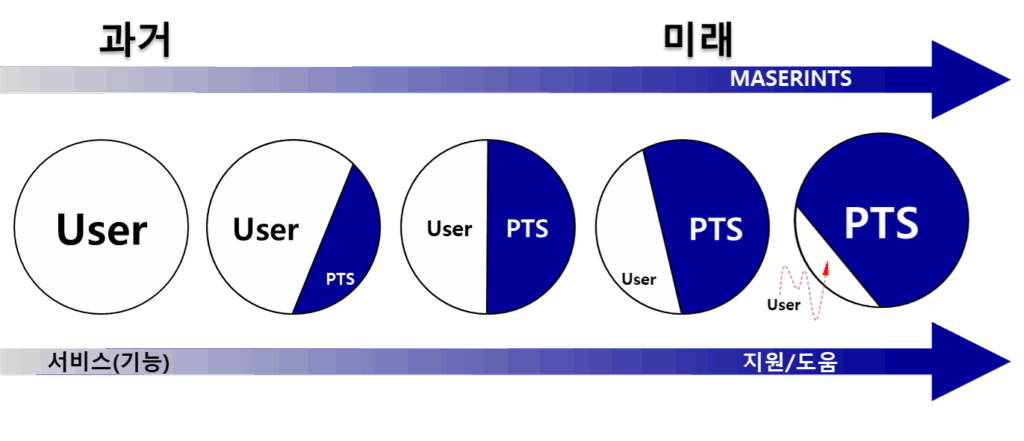

MASERINTS가 추구하는 부분도 이런 부분이다. MASERINTS의 디지털 공간에서는 PTS로부터 나와서 PTS로 돌아가는 것이 대부분이다. 속이 검은 디지털 공간은 대부분이 조정자로부터 나와서 조정자에게도 모든 것이 돌아간다. 대신 사람에게는 자신이 그 공간에 중심에 있다는 환상만 줄 따름이다.

‘HCAI’는 최첨단 기술이라고 할 수 있다. 인간을 중심에 놓는다는 것은 복잡한 인간의 요구와 필요를 어떻게 해서라도 놓치지 않겠다는 것이다. 그래서 이는 인공지능 연구 개발에서 가장 중요한 현재 트렌드 중 하나일 수밖에 없다.

Stanford의 ‘HCAI’ 연구소와 Google ‘DeepMind’를 포함한 주요 기관들이 이러한 접근 방식으로 전환하고 있다고 알려져 있다. 이는 인공지능을 신중하게 구축하지 않으면 의도치 않은 피해를 입히거나 부자연스럽게 느껴질 수 있다는 것에 대해 사람들의 인식이 높아지고 있는 데 대한 궁여지책으로 나온 대응책일 수 있다.

Ubicomp은 컴퓨팅을 환경 곳곳에 내장하여 백그라운드에서 원활하게 작동하도록 하는 것을 목표로 한다. 하지만 “인간 중심적인 접근 방식”이란 비전이 없다면, 그러한 완벽함은 눈에 보이지 않는 조정이나 냉정한 그리고 뻔한 자동화로 변질될 수 있다. 그러면 사람들은 ‘사용자’로, 그리고 ‘사용을 당하는 자’로 전락하고 만다.

‘HCAI’는 이러한 간극을 메우려고 하는 개념적 방향제시일 뿐이다. 즉, 디지털 공간 전반에 분산된 지능이 그 공간의 중심에 있는 사람의 자율성, 감정, 습관, 심지어 불완전함까지 존중하도록 보장한다는 것이다. 결국, 진정한 ‘HCAI’가 Ubicomp을 더욱 인간적으로 만들 수 있는 공간을 제공할 수 있게 되는 것이다. Ubicomp을 기술의 구조와 존재로, ‘HCAI’를 그 기술의 개성과 민감성으로 본다면, 이 둘이 합쳐져 스마트하면서도 배려심 있는 환경을 만들어낸다.

이에 대한 MASERINTS의 이야기를 해 보려고 한다. MASERINTS는 화려한 인터페이스도 없다. 끊임없는 알림에 쫓기지도 않는다. PTS의 맥락에 조용히 적응하며 지원과 도움을 제공한다. PTS의 집중력, 사생활, 그리고 감정 상태를 존중한다. 이것이 바로 MASERINTS의 실제 모습이 될 것이다. MASERINTS는 “어떻게 모든 것을 자동화할 수 있을까?”라고 묻지 않는다. “어떻게 하면 방해 없이 사람들을 더 잘 지원할 수 있을까?”라고 스스로에게 묻는다. MASERINTS에게는 PTS의 삶의 흐름 자체가 인터랙션의 모든 것이다.

MASERINTS는 사람들에게 디바이스 사용에 대한 부담을 주거나 부자연스러운 행동을 요구하지 않는다. PTS가 ‘사용자’의 입장이 되는 경우도 있겠지만, 대부분이 PTS의 입장이 될 것이고, 제공되는 지원과 도움은 그렇게 PTS에게 의식되지 않을 것이다. 다만, 삶의 흐름이 더욱 차분하고 매끄럽게 이어지고 있다는데 만족감을 더할 뿐이다. 그 만족감이 더하면 더할수록 MASERINTS의 지원과 도움은 계속된다는 것이다.

바로 그 점이 MASERINTS의 진정한 차별점이다. 많은 스마트 시스템은 사용자가 특정한 디바이스를 활용해서 끊임없이 명령을 내리는 것에 의존한다. MASERINTS는 현실 속의 사람들은 그것을 원하지 않는다는 것을 인지하고 있다. 사람들은 유기적으로 움직이고, 생각하고, 행동한다. MASERINTS는 조용히 듣고, 맥락을 관찰하며, 이러한 일상의 흐름을 존중하는 방식으로 지원한다. MASERINTS의 인공지능 시스템은 PTS와 같이 성장할 수 있도록 VPTS를 성장시키고, PTS에 대한 개인화를 이룰 수 있게 해주면, 모든 부분에서 개인화된 연산작업(UCA)가 가능해지도록 한다.

MASERINTS는 단순한 디바이스들과 서비스 시스템들이 모여 있는 것이 아니라 PTS만을 알려고 하고, 이해하려고 하는 디지털 공간이다. PTS의 습관을 알고 이해하고, 그래서 PTS가 원하는 분위기 속에서 방해하지 않으면서도 PTS의 요구와 필요를 예측하며, 자연스럽고 매끄럽게 제공되는 디지털 공간을 조성하려는 것이다. 인간중심의 인공지능이 되기 위해서는 PTS의 의식 속에는 MASERINTS가 존재해서는 안된다. 이것이 MASERINTS의 핵심이다.

MASERINTS는 대단위의 다층적인 인프라이다. 공간, 시간, 행동, 맥락, 심지어 기억과 경험까지 아우르는 전체 디지털 공간의 작동 방식을 정의한다. PTS와 디지털 공간 간의 실시간 인터랙션을 수없이 수행하고 관리하여 모든 접점에서 일관된 경험을 제공한다.

MASERINTS은 많은 최신의 기술들을 품고 있는 디지털 공간이다. 주변의 수많은 터미널 시스템과 컴퓨터 디바이스들 간의 인터랙션을 형성하기도 하는데, 이는 PTS를 위한 인터랙션이며, 이런 것 역시 PTS의 의식 안에는 존재하지 않는다. 중요한 것은 MASERINTS의 기능이 아니라, 그 기능들이 어떻게 사려 깊고 인간적인 방식으로 PTS에게 제공되느냐가 중요한 것이다. 시스템이 무엇을 하는지가 아니라 어떻게 하는지가 중요하다. MASERINTS의 공간 지능은 친절하고 적응력이 뛰어나며 PTS를 존중하는 공간을 구성하게 된다. 차분하고, 방해받지 않으며, 온전히 PTS를 지원하고 도움을 주는 디지털 공간을 만드는 것이 MASERINTS의 비전이다. MASETINTS는 인간 중심의 인공지능을 제공하기 위한 절대적인 기준으로 삼을 토대를 가지고 있다는 것이 가장 중요한 핵심이다.

- What is human-centered AI? 2022, https://research.ibm.com/blog/what-is-human-centered-ai

IBM은 ‘Human-centered AI’란 효율성이나 자동화만이 아니라 사람을 위해 작동하는 AI 시스템을 디자인하는 것을 의미한다고 설명한다. 인간 중심적으로 만든다는 것은 신뢰할 수 있고 투명하며 인간의 가치에 부합하는 인공지능 시스템을 만드는 데 중점을 두고 있다는 것이다. 사람을 대체하는 것이 아니라, 인간의 능력을 증강하여 더 잘 생각하고, 결정하고, 행동할 수 있도록 돕는 것이 목표이다.

IBM에서 그런 인공지능을 구축하기 위해 IBM은 윤리, 공정성, 책임성, 사용성 같은 원칙을 강조한다. 기본적으로 인공지능은 이해하기 쉽고, 개인정보를 존중하며, 사람과 함께 디자인되어야 한다. 그렇다면 가장 중요한 아이디어는 인공지능이 인간에게 적응해야 한다는 것이지, 인간이 인공지능에 적응하도록 강요하는 것이 아니라는 것이다. 바로 그것이 핵심이다. 인간 중심의 인공지능을 인간의 존엄성, 안전, 신뢰를 중심에 두면서, 의미 있는 방식으로 우리를 지원하는 기술을 만드는 것이다. 과연 IBM에서 가지고 가는 절대적인 인간의 가치를 정의하는 토대는 무엇일까?

- Human-centered AI, 2025, https://en.wikipedia.org/wiki/Human-centered_AI

- Human-Centered Artificial Intelligence, https://doresearch.stanford.edu/who-we-are/human-centered-artificial-intelligence

- If Done Right, AI Could Make Policing Fairer, Will Knight, 2020. https://www.wired.com/story/done-right-ai-make-policing-fairer

- What is Human-Centeredness in Human-Centered AI? Development of Human-Centeredness Framework and AI Practitioners’ Perspectives, Aung Pyae, 2025, https://arxiv.org/abs/2502.03293

- What is Human-Centered AI (HCAI)?, Interaction Design Foundation, https://www.interaction-design.org/literature/topics/human-centered-ai?srsltid=AfmBOoqRmQTZFXgRCUlhCF7THgJrRYwHwr2Oj3910537ccosG-0hWgLu

Last Updated on 2025년 11월 06일 by MASERINTS